Le problème des actions aveugles

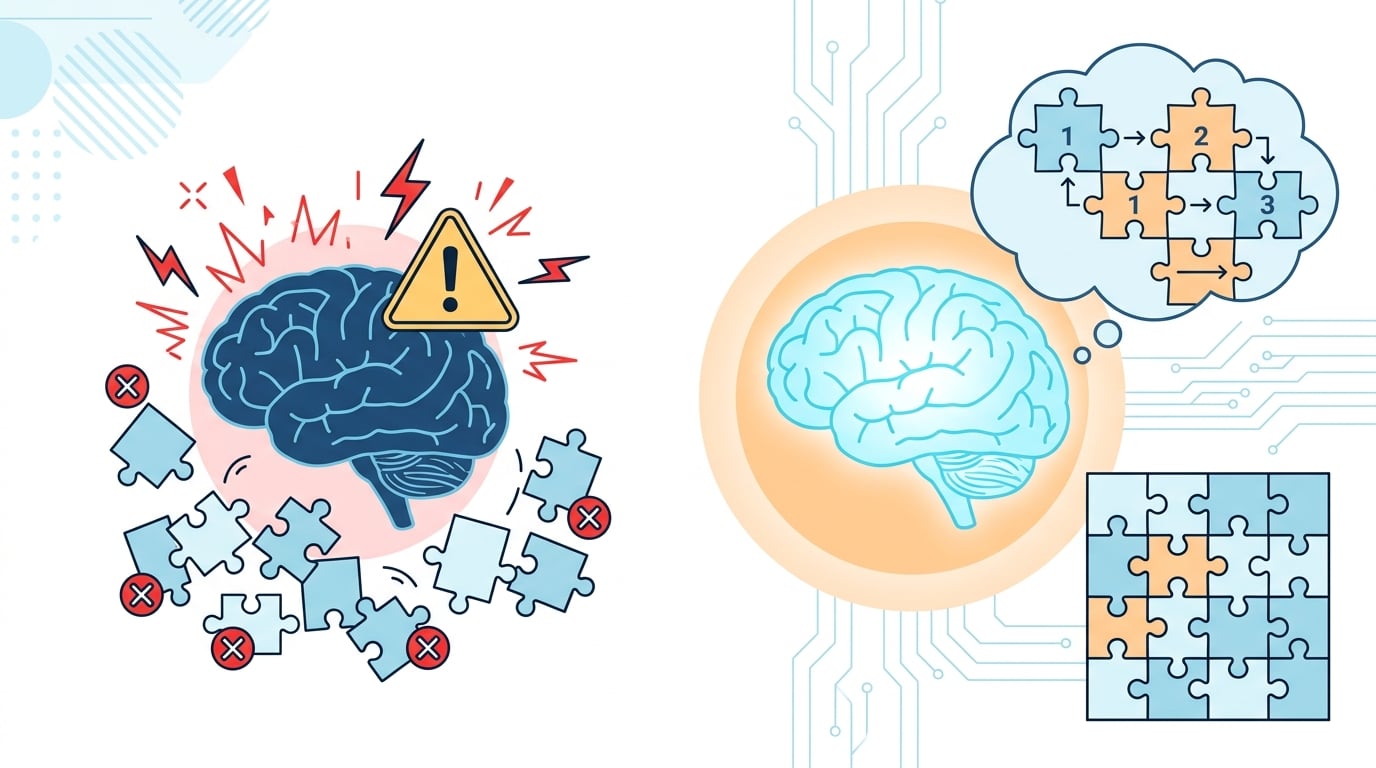

En résolvant des problèmes logiques complexes ou en récupérant plusieurs éléments d'information, forcer un modèle IA à décider immédiatement une action peut entraîner des erreurs désastreuses.

Pensez à la manière dont un humain résout un puzzle à pièces :

- Ils ne prennent pas une pièce au hasard et ne l'enfoncent pas directement dans le tableau.

- Ils élaborent mentalement ou verbalement une stratégie : "D'abord, je dois trouver les pièces aux bords droits pour la bordure, puis je verrai si cette pièce bleue convient."

De même, si nous incitons un IA à seulement générer une action — en sautant la phase de raisonnement — elle agit de manière « aveugle ». Elle devine souvent, fait des hallucinations ou choisit complètement le mauvais outil, car elle n’a pas établi les préalables nécessaires pour répondre à la question.

Penser à voix haute

Les modèles linguistiques construisent la logique mot par mot. En obligeant l’IA à « penser à voix haute » (générer un texte analysant le problème) avant de choisir une action, nous lui fournissons l'espace nécessaire pour parvenir à la conclusion logique correcte.